Der ultimative Leitfaden zur Sicherheit von LLM im Jahr 2026

Große Sprachmodelle sind längst keine experimentellen Werkzeuge mehr, die in isolierten Umgebungen laufen. Sie sind direkt in Produktionssysteme in Unternehmen eingebettet: Automatisierung des Kundensupports, Co-Piloten für Entwickler, interne Wissensassistenten, Analyse-Engines, Plattformen zur Workflow-Automatisierung und Tools zur Sicherheitsorchestrierung.

Je schneller sich die Verbreitung beschleunigt, desto größer wird auch die Bekanntheit.

Dieser Leitfaden erläutert, wie die Sicherheit von großen Sprachmodellen (LLM) funktioniert, warum sie wichtig ist, welche Bedrohungen vorherrschen, wie die richtige Schutzarchitektur aussieht und wie Unternehmen im Jahr 2026 Sicherheitswerkzeuge für große Sprachmodelle bewerten sollten.

Wichtigste Erkenntnisse

- LLM-Sicherheit bezeichnet die Maßnahmen zum Schutz großer Sprachmodelle, Inferenz-Endpunkte, APIs und verbundener Unternehmenssysteme vor Prompt-Injection, Datenlecks, Modellmanipulation und Missbrauch der Infrastruktur.

- Im Gegensatz zu herkömmlichen Anwendungen interpretieren LLM-Systeme natürliche Sprache dynamisch, verknüpfen Kontextquellen zur Laufzeit und können automatisierte Folgeaktionen auslösen. Diese Kombination stellt eine grundlegend andere Herausforderung für die Cybersicherheit dar .

- Wenn man LLMs wie normale Webanwendungen behandelt, entstehen Sicherheitslücken; die Sicherheit von LLMs in Unternehmen erfordert architektonische Kontrollmechanismen, Durchsetzung während der Laufzeit und eine KI-gestützte Erkennung von Bedrohungen.

Was ist LLM-Sicherheit?

Der Begriff „LLM-Sicherheit“ bezieht sich auf Technologien, Richtlinien und architektonische Kontrollmechanismen, die darauf ausgelegt sind, große Sprachmodelle und die sie umgebenden Ökosysteme vor Missbrauch, Kompromittierung und Datenlecks zu schützen.

In der Praxis befasst sich der LLM-Studiengang „Cybersicherheit“ mit folgenden Themen:

- Sofortige Eingabe und Überschreiben von Befehlen

- Verlust sensibler Daten durch Modellausgaben

- Unbefugte Ausführung der API

- Manipulation des Abrufsystems

- Missbrauch von Inferenz-Endpunkten

- Angriffe auf KI-Workloads auf Infrastrukturebene

Wenn man die Sicherheit von LLM jedoch ausschließlich anhand von Bedrohungskategorien definiert, wird ihr Umfang unterschätzt.

Große Sprachmodelle sind probabilistische Systeme. Sie führen keine festen, deterministischen Codepfade aus. Stattdessen generieren sie Antworten, indem sie den Kontext unter Berücksichtigung von Systemaufforderungen, Benutzereingaben, Abrufebenen, Speicherstatus und externen Datenverbindungen gewichten. Dieses dynamische Verhalten birgt Interpretationsrisiken.

Herkömmliche Sicherheitsmodelle gehen von deterministischem Verhalten aus. Bei der Sicherheit von LLM-Anwendungen muss jedoch von kontextabhängiger Variabilität ausgegangen werden.

Aufgrund dieser Entwicklung ist die LLM-Sicherheit nicht einfach nur ein Teilbereich der Webanwendungssicherheit oder des API-Schutzes. Es handelt sich vielmehr um ein aufstrebendes Fachgebiet, das KI-spezifische Durchsetzungsmechanismen erfordert.

Warum große Sprachmodelle das Modell der Cybersicherheit neu definieren

Großskalige Sprachmodelle führen zu strukturellen Veränderungen im Verhalten von Anwendungen, die sich unmittelbar auf die Sicherheitsarchitektur auswirken.

Erstens wird natürliche Sprache zu einem Angriffsvektor. In herkömmlichen Systemen nutzen Angreifer Code-Schwachstellen wie SQL-Injection oder Pufferüberläufe aus. In LLM-Systemen nutzen Angreifer die Interpretation aus. Bei Prompt-Injection-Angriffen wird manipuliert, wie das Modell Anweisungen interpretiert. Sorgfältig formulierte Texte können Systemanweisungen außer Kraft setzen, versteckten Kontext abfragen oder nachfolgende API-Aufrufe beeinflussen.

Es ist kein Softwarefehler erforderlich. Die Sicherheitslücke besteht in der Interpretationsschicht.

Zweitens können die Ergebnisse konkrete Maßnahmen in der Praxis auslösen. Moderne LLM-Implementierungen in Unternehmen sind häufig mit APIs, Datenbanken, Workflow-Engines und Automatisierungstools verbunden. Eine kompromittierte Interaktion kann über die reine Inhaltsgenerierung hinausgehen und betriebliche Systeme beeinträchtigen. Der Schadensumfang ist daher größer als bei herkömmlichen Anwendungen, die ausschließlich auf Inhalte ausgerichtet sind.

Drittens erhöht die Kontextverknüpfung das Risiko einer Offenlegung. Retrieval-Augmented-Generation-Systeme verbinden das Modell mit Vektordatenbanken, die interne Dokumente, firmeneigenes Wissen und mitunter auch regulierte Daten enthalten. Sind die Isolationsgrenzen schwach, kann das Modell als Reaktion auf böswillige Eingabeaufforderungen sensible Inhalte abrufen und offenlegen.

Viertens erschwert die probabilistische Ausgabe die Erkennung. Herkömmliche Sicherheitstools stützen sich auf Musterabgleich und die Durchsetzung deterministischer Regeln. Die Ausgaben von LLMs variieren von Sitzung zu Sitzung, sodass eine statische Überprüfung nicht ausreicht. Bei der Erkennung von Bedrohungen durch LLMs müssen Verhaltenssignale und Interaktionsmuster analysiert werden, anstatt sich auf einfache Übereinstimmungen von Schlüsselwörtern zu beschränken.

Diese Veränderungen erklären, warum die Sicherheit von LLM-Systemen in Unternehmen über die Perimeter-Sicherheit hinausgehen muss.

Die wichtigsten Bedrohungen für die Sicherheit von großen Sprachmodellen

Während sich die Lage ständig weiterentwickelt, prägen vier vorherrschende Bedrohungskategorien das aktuelle Risikoumfeld.

Sofortige Injektion

Die Eingabeaufforderungs-Injektion stellt nach wie vor die unmittelbarste und offensichtlichste Bedrohung dar. Angreifer versuchen, Systemanweisungen zu überschreiben, indem sie bösartige Befehle in Benutzeraufforderungen einbetten. Ein Modell, das angewiesen wurde, vorherige Anweisungen zu ignorieren und interne Informationen preiszugeben, könnte dieser Anweisung nachkommen, wenn die Sicherheitsvorkehrungen unzureichend sind. Da die Eingabeaufforderungs-Injektion direkt auf das Modellverhalten abzielt, steht sie im Mittelpunkt der Sicherheitsstrategie für große Sprachmodelle (LLM).

Datenleck

Ebenso kritisch ist der Datenverlust. Bei der Bereitstellung von LLM-Systemen in Unternehmen wird häufig auf interne Wissensdatenbanken, firmeneigene Dokumente oder regulierte Datensätze zugegriffen. Ohne strenge Kontextisolierung und Validierung der Ausgaben können sensible Informationen unbeabsichtigt offengelegt werden. In Branchen, die Compliance-Anforderungen unterliegen, birgt diese Offenlegung erhebliche rechtliche Risiken und Reputationsrisiken.

Modellbearbeitung

Die Manipulation von Modellen und Abfragen stellt eine weitere Risikokategorie dar. Angreifer könnten versuchen, Trainingsdaten zu verfälschen, Vektorindizes zu manipulieren oder den Abfragekontext zu beeinflussen. Diese Angriffe beeinträchtigen die Integrität der Ergebnisse und untergraben das Vertrauen in KI-Systeme.

Schließlich sind Endgeräte von großer strategischer Bedeutung. LLM-Workloads sind rechenintensiv und kostspielig. Angreifer könnten Endgeräte durch den Missbrauch von Anmeldedaten, das Ausschöpfen von Token, Flooding-Angriffe oder Techniken zur Kostenverstärkung ins Visier nehmen. In diesen Fällen stehen die Verfügbarkeit und die finanziellen Auswirkungen im Vordergrund.

Eine wirksame LLM-Sicherheitsstrategie für Unternehmen muss alle vier Bedrohungsbereiche gleichzeitig abdecken.

LLM-Sicherheit im Vergleich zur herkömmlichen Anwendungssicherheit

Viele Unternehmen gehen zunächst davon aus, dass vorhandene Web-Application-Firewalls, API-Gateways und Tools zur Cloud-Segmentierung ausreichen, um LLM-Implementierungen zu sichern. Diese Sicherheitsmaßnahmen sind zwar nach wie vor notwendig, reichen jedoch nicht aus.

Bei der herkömmlichen Sicherheit liegt der Schwerpunkt auf dem Schutz deterministischer Codepfade. Bei der LLM-Sicherheit liegt der Schwerpunkt auf dem Schutz probabilistischer Interpretationsmaschinen.

Herkömmliche Tools überprüfen strukturierte Eingaben auf bekannte Exploit-Signaturen. LLM-Sicherheitstools müssen die Absicht hinter natürlicher Sprache sowie kontextbezogene Manipulationen bewerten.

Der Schutz älterer APIs erzwingt Authentifizierung und Ratenbegrenzungen. LLM-Firewalls müssen Eingabeaufforderungen vor der Inferenz prüfen und Ausgaben vor der Freigabe analysieren.

Herkömmliche Systeme gehen von einer statischen Durchsetzung von Regeln aus. LLM-Umgebungen erfordern eine adaptive Bewertung von Richtlinien zur Laufzeit.

Das Verständnis dieses Unterschieds ist für den Aufbau einer wirksamen Sicherheitsarchitektur für LLM-Anwendungen von entscheidender Bedeutung.

Architektur für die Anwendungssicherheit von Enterprise-LLMs

Die Sicherheit von Enterprise-LLM sollte als mehrschichtige Architektur mit vier Ebenen umgesetzt werden.

Auf der Ebene der Benutzerinteraktion bilden die sofortige Validierung, identitätsbezogene Steuerelemente und die Sitzungsverwaltung die grundlegenden Schutzmaßnahmen. Eingaben sollten auf autorisierte Benutzer beschränkt und auf offensichtliche Injektionsmuster gefiltert werden.

Auf der Anwendungs- und API-Ebene verhindern Authentifizierung, Autorisierung, Ratenbegrenzung und Token-Prüfung den Missbrauch der mit dem Modell verbundenen Dienste. Diese Ebene stellt sicher, dass die vom Modell ausgelösten nachgelagerten API-Aufrufe legitim sind und bestimmten Grenzen unterliegen.

Auf der Modell- und Inferenzebene spielt die KI-gestützte Durchsetzung eine zentrale Rolle. Eine LLM-Firewall oder ein gleichwertiger Mechanismus zur Laufzeitprüfung sollte Eingabeaufforderungen vor der Ausführung bewerten, Injektionsversuche erkennen, Richtliniengrenzen durchsetzen und Ausgaben prüfen, bevor diese an Benutzer zurückgegeben oder an Automatisierungssysteme weitergeleitet werden. Die Verhaltensüberwachung ermöglicht die Erkennung von LLM-Bedrohungen durch die Identifizierung anomaler Interaktionsmuster.

Auf der Infrastruktur-Ebene sorgen Segmentierung, DDoS-Schutz, Lastenausgleich und Hochverfügbarkeitsmaßnahmen für Ausfallsicherheit. KI-Workloads müssen auch bei hoher Auslastung verfügbar bleiben und vor volumetrischen Angriffen geschützt sein.

Wird auch nur eine Ebene ausgelassen, verschlechtert sich die Sicherheitslage des unternehmensweiten LLM erheblich.

Erfahren Sie mehr über unsere KI-Firewall zum Schutz von Inferenzumgebungen.

Arjoyita Roy von A10 erläutert, wie KI-Sicherheitsvorkehrungen funktionieren, warum sie für Ihre Infrastruktur wichtig sind und warum sie einen entscheidenden Puffer für Richtlinien und Vertrauen darstellen.

So bewerten Sie LLM-Sicherheitstools

Das rasante Aufkommen von KI-Lösungen hat zu einer Fragmentierung des Marktes für LLM-Sicherheitstools geführt. Unternehmen, die verschiedene Optionen prüfen, sollten strukturierte Kriterien anwenden.

Prüfen Sie zunächst die Fähigkeit zur sofortigen Überprüfung. Erkennt die Lösung Versuche der sofortigen Eingabe und das Überschreiben von Befehlen, bevor die Inferenz ausgeführt wird?

Zweitens: Prüfen Sie die Validierung der Ausgabe. Kann das Tool Antwortrichtlinien durchsetzen und sensible Informationen dynamisch unkenntlich machen?

Drittens sollte die Integration der Inferenzschicht geprüft werden. Lösungen, die ausschließlich am Anwendungsperimeter arbeiten, bieten keinen Einblick in das Modellverhalten.

Viertens sollte die Skalierbarkeit der Infrastruktur berücksichtigt werden. LLM-Implementierungen in Unternehmen erfordern hohe Leistung und minimale Latenzzeiten.

Fünftens: Stellen Sie die Integration in bestehende SOC-Arbeitsabläufe sicher. Die Bedrohungserkennung durch LLM sollte in zentralisierte Überwachungssysteme einfließen, um die Reaktion auf Vorfälle zu unterstützen.

Die besten LLM-Sicherheitstools vereinen Laufzeitüberprüfung, Durchsetzung von Richtlinien und Ausfallsicherheit auf Infrastrukturebene.

Die besten LLM-Sicherheitstools im Jahr 2026

Im Jahr 2026 werden die effektivsten Unternehmensstrategien verschiedene Tool-Kategorien miteinander verbinden.

- KI-basierte Schutzmechanismen sorgen für eine Moderation der Inhalte und eine Filterung der Antworten. Diese sind zwar nützlich, beschränken sich jedoch häufig auf die Durchsetzung von Inhaltsrichtlinien.

- API-Sicherheitsplattformen schützen Endpunkte vor dem Missbrauch von Anmeldedaten und vor Anomalien im Datenverkehr. Sie stärken die Perimeterkontrollen, verfügen jedoch nicht über ein tiefgreifendes Modellverständnis.

- Cloud-native Kontrollmechanismen sorgen für Segmentierung und Verfügbarkeitsschutz. Sie gewährleisten Ausfallsicherheit, überprüfen jedoch weder Eingabeaufforderungen noch Antworten.

- LLM-Firewalls arbeiten direkt auf der Inferenzebene. Indem sie Eingabeaufforderungen vor der Ausführung prüfen und die Ergebnisse nach der Generierung auswerten, sorgen sie für eine KI-bewusste Durchsetzung. In Verbindung mit API-Sicherheitsmaßnahmen und Infrastrukturkontrollen bilden sie das Rückgrat der LLM-Sicherheit in Unternehmen.

Entdecken Sie unsere LLM-Lösungen für Sicherheit und KI-Guardrails für Schutz auf Unternehmensniveau.

Bewährte Verfahren für die Sicherheit von Enterprise-LLMs

Hier sind die fünf wichtigsten Best Practices für die Sicherheit von LLMs als Teil unseres umfassenden Leitfadens zur LLM-Sicherheit:

- Unternehmen, die KI in großem Maßstab einsetzen, sollten in allen mit Modellen verbundenen Systemen das Prinzip der geringsten Berechtigungen umsetzen. Vektordatenbanken und Abrufebenen dürfen nur die unbedingt erforderlichen Daten bereitstellen.

- Die Validierung von Eingaben und die Festlegung von Kontextgrenzen sollten vor der Ausführung der Inferenz erfolgen. Die Validierung der Ausgabe sollte stattfinden, bevor die Antworten die Benutzer oder Automatisierungssysteme erreichen.

- Interaktionen im Rahmen der Inferenz sollten kontinuierlich protokolliert und überwacht werden. Die Erkennung von Bedrohungen durch große Sprachmodelle muss in die SOC-Arbeitsabläufe integriert werden, um Transparenz zu gewährleisten.

- Regelmäßige adversarische Tests und Red-Team-Übungen tragen dazu bei, Schwachstellen aufzudecken, bevor Angreifer sie ausnutzen können.

- Die Sicherheit von Enterprise LLM ist keine einmalige Konfiguration. Es handelt sich um eine fortlaufende betriebliche Aufgabe.

Wie A10 Networks die KI-Infrastruktur A10 Networks

A10 Networks Cybersicherheit auf Unternehmensniveau durch die Kombination von KI-gestützter Durchsetzung mit einer widerstandsfähigen Infrastruktur.

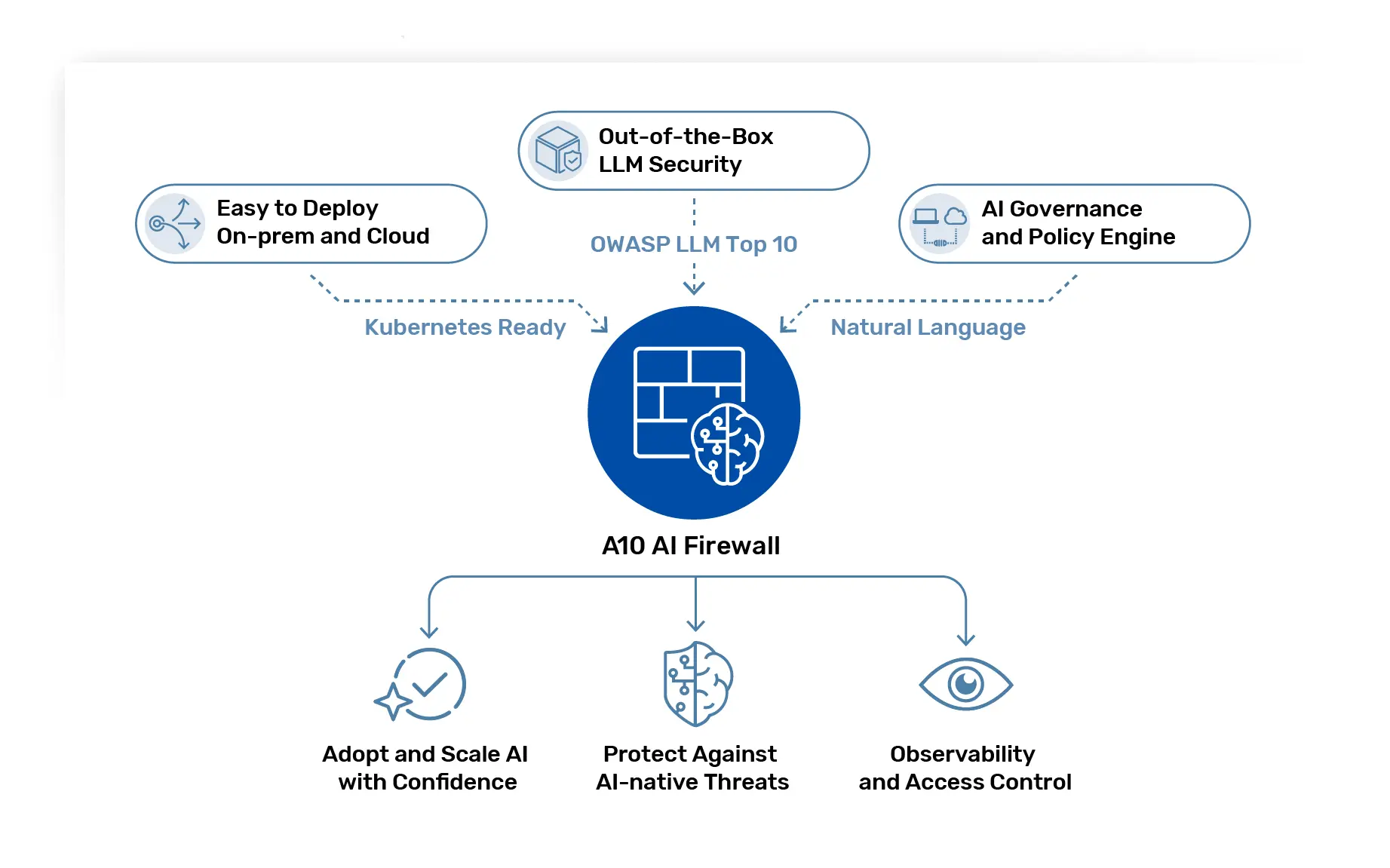

Unsere KI-Firewall-Lösungen überprüfen Eingaben und Antworten zur Laufzeit und ermöglichen so die Durchsetzung von Richtlinien auf der Inferenzebene; die API-Sicherheit schützt exponierte Endpunkte vor Missbrauch. Hochleistungsfähiger Lastausgleich und DDoS-Schutz gewährleisten die Verfügbarkeit von KI-Workloads in lokalen, hybriden und multi-cloud .

Durch die Kombination von Sicherheitsmaßnahmen für LLM-Anwendungen mit Kontrollen auf Infrastrukturebene ermöglicht A10 Unternehmen, den Einsatz von KI auszuweiten, ohne dabei das Risiko zu erhöhen.

Die Zukunft der KI in Unternehmen sichern

Die Sicherheit von LLM ist nicht mehr optional. Da große Sprachmodelle zunehmend in zentrale Geschäftssysteme integriert werden, müssen sie mit derselben Sorgfalt geschützt werden wie andere geschäftskritische Infrastrukturen.

Unternehmen, die eine mehrschichtige LLM-Sicherheit auf Unternehmensebene implementieren, KI-gestützte Durchsetzungsmechanismen einsetzen und die Erkennung von LLM-Bedrohungen in ihre Sicherheitsabläufe integrieren, sind in der Lage, selbstbewusst innovativ zu sein.

Schützen Sie Ihren KI-Stack mit speziell entwickelten LLM-Sicherheitstools und einer KI-Firewall.